在AI大模型百花齐放的今天,DeepSeek R1以其卓越的性价比、出色的写作能力、清晰的推理过程、优质的回答质量以及针对中文的深度优化,迅速赢得了广大Make用户和自动化爱好者的青睐。然而,由于计算资源有限和全球用户激增,访问困难的问题日益凸显。本文将为您详细介绍在Make自动化工作流中可调用的DeepSeek R1平台,助您突破访问瓶颈,实现高效集成。

支持 Make 集成的DeepSeek R1 调用平台

DeepSeek 官方 API 平台

平台特色

作为官方提供的调用渠道,DeepSeek API 平台为Make用户提供了最直接、最稳定的模型调用服务。通过 https://api.deepseek.com 的基准 URL,Make用户可以使用 OpenAI SDK 或其他兼容软件轻松接入。其中,DeepSeek-R1 模型可通过 model='deepseek-reasoner' 参数调用。

核心优势

- 官方技术支持,确保模型更新及时

- API 接口与 OpenAI 完全兼容,降低使用门槛

- 鉴于全球的持续火爆,稳定性有待提高

Make 支持

- 提供原生 Make 模块,支持直接集成

- 提供详细的 API 文档和提示词示例

作为官方提供的调用渠道,该平台无疑是Make用户的最优选择,其简单高效的特性能够满足大多数自动化需求。虽然目前存在一定的稳定性挑战,但随着官方的持续改进和优化,相信未来将能够提供更加稳定可靠的调用服务。

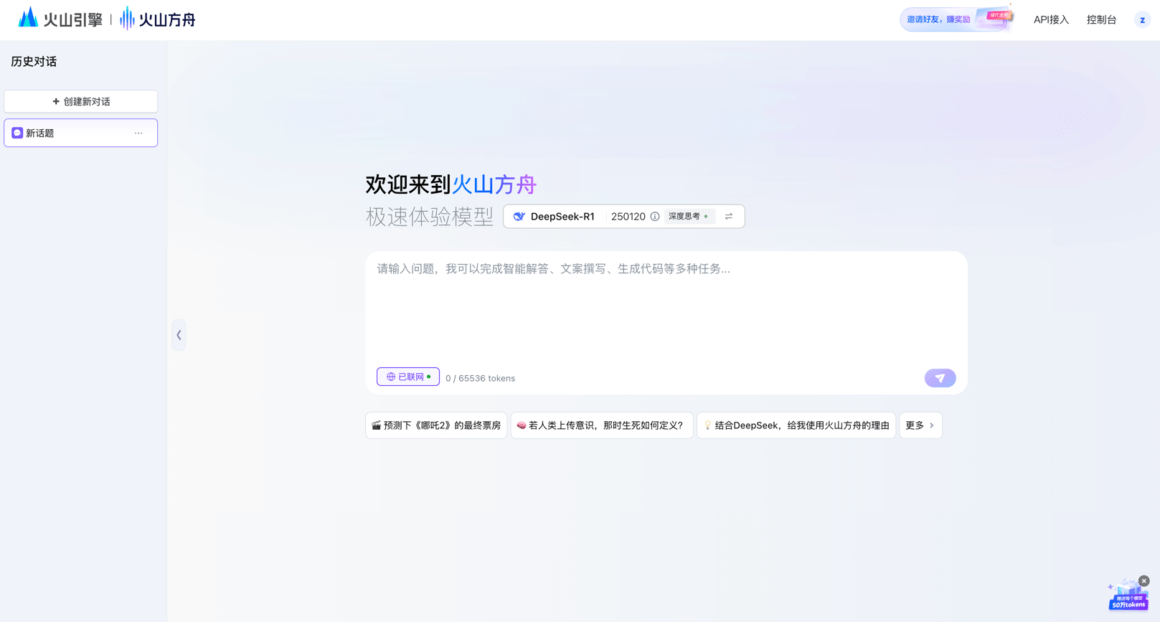

字节火山引擎

核心优势

火山引擎提供了 DeepSeek R1 和 V3 两个大语言模型的调用服务。在调用限制方面,火山引擎对这两个模型采取了非常友好的策略 – 支持每分钟3万次请求(RPM)以及每月500万次调用(TPM)的不限速访问,完全能满足大规模应用的需求。这样的高并发支持让开发者可以放心地将这些模型应用到生产环境中。

使用建议

翔宇测试发现,火山引擎在实际应用中展现出了优异的性能表现。首先在调用速度方面,其响应时间非常快速,能够满足实时交互的需求。这种快速响应不仅提升了用户体验,也为开发者提供了更好的调试环境。

在输出结果的处理上,火山引擎将AI的思考过程和最终输出结果分开存储。这种设计在make工作流中特别有价值,因为它允许开发者和质量控制人员详细检查AI的推理过程,确保输出结果的质量和可靠性。通过分析存储的思考过程,我们可以更好地理解模型的决策机制,也便于进行错误分析和系统优化。

在系统稳定性方面,火山引擎表现出色。长期测试显示其具有极高的系统可用性和请求成功率。即使在高负载情况下,系统依然能够保持稳定的性能表现。这种可靠的系统稳定性,加上优秀的错误处理机制,让开发者可以放心地将其部署在生产环境中。

综合来看,火山引擎不仅提供了强大的模型能力,还在性能、可用性和开发者友好度等多个维度都做出了令人满意的表现,是一个值得信赖的AI服务平台。

OpenRouter 聚合平台

平台特色

OpenRouter 作为 AI 模型 API 的聚合平台,为自动化爱好者提供了 DeepSeek R1 的免费和付费版本调用服务。用户可通过 deepseek/deepseek-r1:free 调用免费版本,或使用付费版本deepseek/deepseek-r1获得更加稳定的效果。

核心优势

- 提供免费试用版本,降低使用成本

- 支持多模型切换,方便功能对比

- 统一的 API 接口,简化集成流程

Make 支持

- 提供原生 Make 模块,支持快速集成

- 提供详细的集成文档

使用建议

作为Make自动化工作流的最佳搭档,OpenRouter平台集成了海量AI模型,为Make 用户提供了便捷的模型效果对比功能。特别适合在测试工作流效果时进行多模型对比,通过对比选择大模型来实现更佳的输出质量。建议在项目初期优先使用其免费版本进行功能验证和效果调优。

Together AI 专业平台

平台特色

Together AI 作为翔宇测试中表现最为稳定的专业平台,专注于大语言模型的运行和服务。虽然价格相对较高,但为 DeepSeek R1 提供了最专业的调用环境。平台不仅支持 API 调用,还提供模型微调、部署等高级功能,是追求稳定性的首选方案。

核心优势

- 专业的模型运行环境,确保高性能

- Make 平台通过 HTTP API 调用,支持稳定集成

- 支持模型微调和定制化部署

- 提供详细的性能监控和优化建议

Make 支持

- 通过 HTTP API 调用,支持稳定集成

- 是目前最稳定的 Make 集成方案

使用建议

如果 Make 用户希望稳定高效地运行 DeepSeek R1 模型,那么选择 Together AI 即可。无需担忧每次工作流运行后没有数据输出或出现各种代码报错,Together AI 提供了最简单、最稳定的解决方案。

硅基流动(SiliconCloud)云平台

平台特色

硅基流动是由硅基流动公司推出的一站式大模型云服务平台,旨在为Make用户和企业提供高效、低成本且全面的生成式人工智能(GenAI)模型服务。通过优化大模型使用体验,帮助用户以更低成本和更高效率使用先进的大语言模型(LLMs)及其他生成式人工智能(AI)模型。

核心优势

- 自研推理引擎在速度和成本上均达到业界领先水平

- 与华为云昇腾云服务深度集成,提供稳定高效的推理性能

- 提供丰富的接口配置,支持Temperature、Top-P、Top-K等超参数调整

DeepSeek R1 支持

- 在 DeepSeek V3 和 R1 发布后快速跟进支持

- 联合华为云推出基于昇腾云的 DeepSeek R1&V3 推理服务

- 提供 API 调用,解决服务器繁忙问题

- 优惠期价格:DeepSeek-R1 为 ¥4 / M tokens(输入)& ¥16 / M tokens (输出)

使用建议

硅基流动云平台为DeepSeek R1提供了全方位的API调用服务,有效解决了服务器负载过高的问题。作为国内领先的大模型服务平台,它不仅为DeepSeek R1打造了专业级的调用环境,更提供了从基础API调用到模型微调、部署等一站式高级功能。平台支持海量模型的无缝切换,配合便捷的支付系统,是国内Make用户使用DeepSeek R1的首选平台。

总结

综合各平台表现,Make 用户在选择 DeepSeek R1 调用平台时可根据项目需求灵活决策:对于国内用户来说,火山引擎凭借其高性能的服务和友好的调用限制,是最优先的选择;对于追求极致稳定性的生产环境,Together AI 提供专业的模型运行环境和完善的 HTTP API 集成方案,也是非常可靠的选择;待 DeepSeek 官方平台服务更加稳定成熟后,其原生支持将是最佳方案。此外,OpenRouter 的多模型对比功能适合测试阶段使用,而硅基流动云平台则为国内用户提供了另一个高性能、低成本的选择。