学员实践:openbili AI 接入驾驶舱介绍

Calvin 是「翔宇工作流」的学员,方向是 AI 模型中转。他把这件事做成了独立站点「openbili」,覆盖 OpenAI SDK 兼容、模型路由、调用成本可见、失败可解释。本文将其介绍给关注同方向的读者。

用 n8n 自动化 Gemini 大模型微调的完整流程,小白也能轻松上手任意大模型定制。工作流覆盖训练数据采集清洗、JSONL 格式转换、Google Vertex AI 微调任务提交、训练监控和模型评估全链路。教程涵盖微调数据质量标准、超参数选择指南、Vertex AI API 配置和微调前后效果对比评估方法,附赠真实女性作家风格微调案例。

以前我做 IP 风格注入,是把自己的经历、观点、写作特征全部塞进提示词里。效果还可以,但有两个明显的瓶颈——提示词越来越长导致上下文拥挤,而且每次调用都要重复传入大段的人设描述。

我是翔宇。翔宇实际完成过多次 Gemini 微调实验,把整个流程自动化后发现小白也能轻松上手。

微调提供了一条完全不同的路径。你不再需要在提示词里反复强调"你是什么风格",而是直接把风格"烙印"到模型的权重里。微调后的模型天生就会用你的方式写作,就像一个学过你所有文章的写手。

这期视频我用 100 篇女性作家的文章微调了 Gemini 2.5 Pro,再通过 n8n 工作流批量生成内容。结果出乎意料——模型不仅学会了第一人称代入、犀利批评、故事化叙事这些表面风格,还学会了把明星事件映射到职场困境、把游戏体验升华为人生哲理这种深层的思维模式。

本教程配套视频已发布在 YouTube,建议搭配视频一起学习效果更佳。

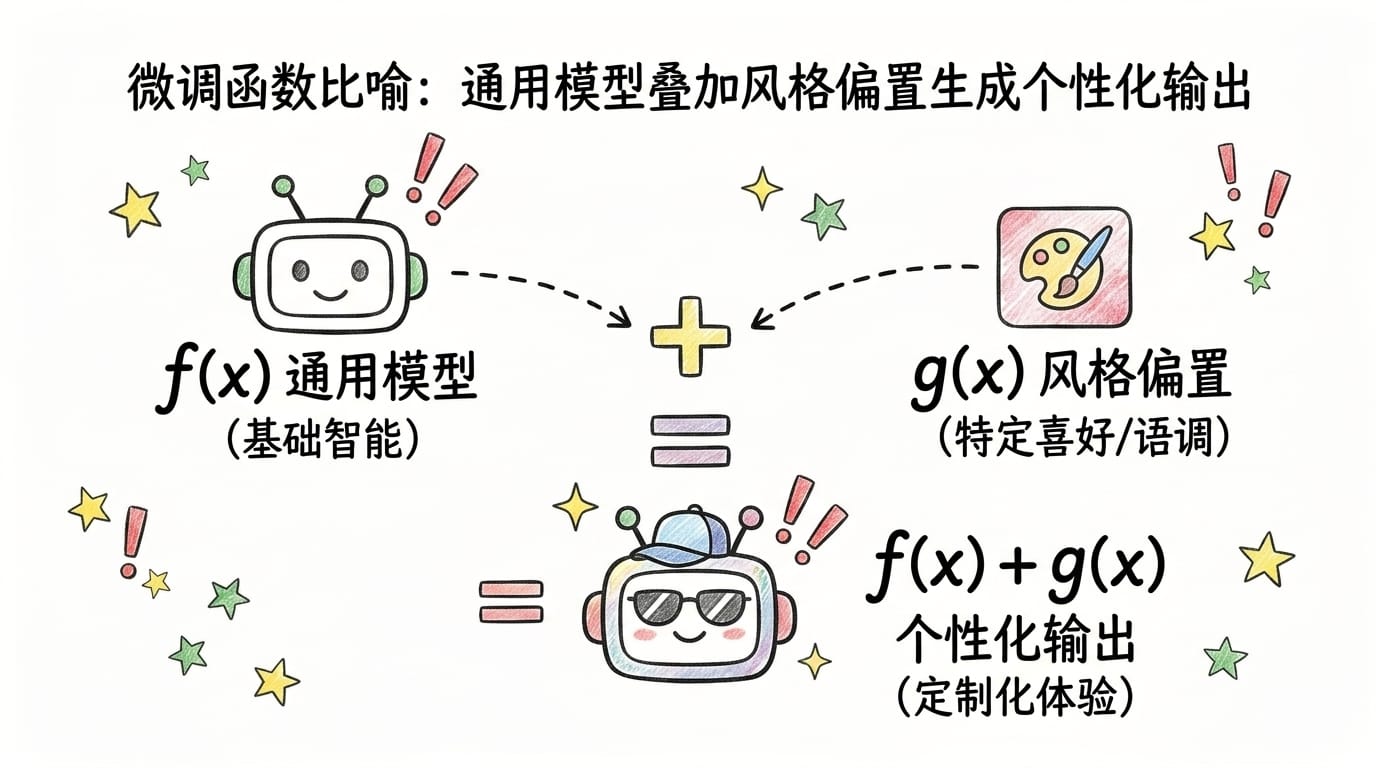

理解微调最简单的方式是把它想象成一个函数。

通用大模型就像一个万能函数 f(x),输入任何问题都能给出一个还不错的答案。但它的输出是"通用"的——缺乏你的风格、你的观点、你的表达习惯。

微调就是在这个通用函数上叠加一个"风格偏置" g(x),让输出从 f(x) 变成 f(x) + g(x)。这个 g(x) 不改变模型的通用能力,但会让所有输出都带上你的风格印记。

提示词工程能做到的事情很多,但有三个场景它力不从心:

风格深度不够。 你可以在提示词里写"用犀利的语气、第一人称代入、善用比喻",大模型会照做,但那种自然流露的风格感是模仿出来的——提示词越具体,写出来的文章反而越像在"表演"风格而不是"拥有"风格。

上下文成本高。 每次调用都要传入几千字的人设描述,既浪费 Token 又挤占了有效上下文的空间。尤其是生成长文时,人设提示词和内容提示词争夺注意力,效果打折扣。

一致性难保证。 批量生成 100 篇文章,每篇的风格可能都有微妙的差异——因为大模型对提示词的理解存在随机性。微调则把风格固化到了权重里,一致性天然有保障。

我选取了 12 个不同领域的主题来验证微调效果,每个主题都展现了鲜明的风格特征:

独特视角与第一人称代入。 给它"辛芷蕾获奖"这个关键词,它写出来的不是"某演员获奖"的客观报道,而是"这一刻我承认我有点心疼她"这样的第一人称叙事。这种拉近距离的代入感,是提示词很难稳定复现的。

犀利批评。 韩剧台词争议的主题,它直接写"说实话挺活该的"——用词尖锐、观点鲜明,不回避批判立场。

现实映射。 赵露思手撕前东家的八卦新闻,它没有停留在娱乐层面,而是把明星困境映射到每个职场人的处境:"当一份工作从滋养你变成消耗你的时候,拿出老子不干了的勇气。"

女性视角。 最出乎意料的一篇是"资产代币化"——一个纯技术金融话题,它居然写成了"今天我不谈冰冷的技术,我想带你认识这场革命背后三位正在悄悄改写游戏规则的女性"。这种"跑题"恰恰是微调的价值——它不是执行指令,而是用学到的思维模式重新组织信息。

隐喻化表达。 黑暗之魂游戏主题,标题是"失败一万次,我才学会和痛苦共处"。结尾是"战胜的不是 Boss,而是那颗被挫败感吞噬的自己"——把游戏体验升华为人生感悟,这是原始数据中深层思维模式的迁移。

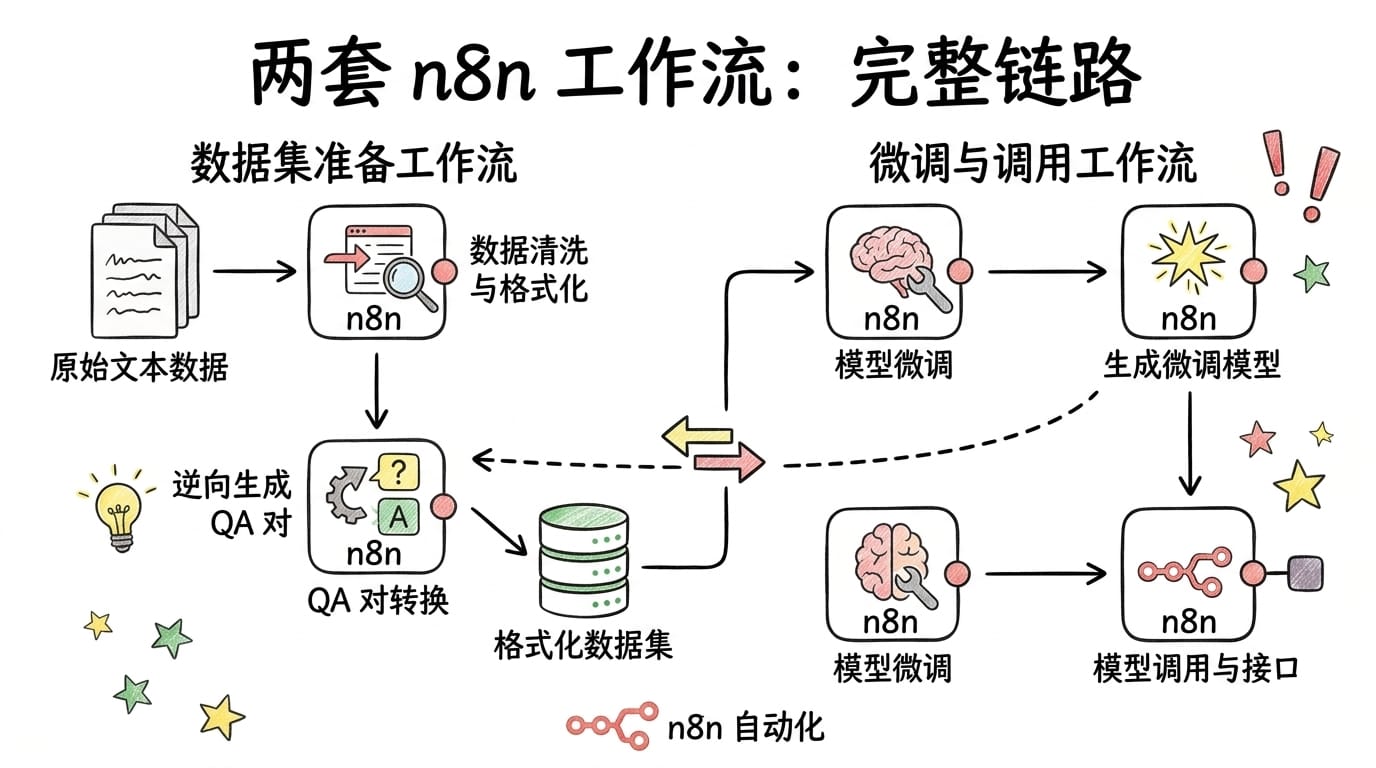

整个微调流程通过两套 n8n 工作流完成:

工作流一:数据集准备。 表单输入原始文章文本 -> 调用 Gemini 逆向生成问答对(基于我设计的逆向提示词框架,从文章中提炼出 QA 格式的训练数据)-> 自动清洗和去重 -> 按比例切分为训练集和验证集 -> 输出符合 Gemini 微调格式的 JSONL 文件。

工作流二:微调与调用。 将数据集上传到 Google Cloud Storage -> 通过 Vertex AI API 启动微调任务 -> 任务完成后获取微调模型的端点 ID -> 在 n8n 中直接调用微调模型生成文章 -> 自动配图和 Markdown 格式化。

关键提示词——逆向生成框架。 这个框架让大模型从一篇文章中反推出"如果要写出这样的文章,应该问什么问题、给什么回答"。它不是简单地切割原文,而是提炼写作意图和风格特征,生成高质量的训练数据。

Google Vertex AI:微调 Gemini 系列模型的官方途径,效果最好,支持 2.5 Pro 和 2.5 Flash。需要谷歌云账号和信用卡。

Together AI:支持开源模型的微调,操作简单,成本较低。适合预算有限或想微调 LLaMA 等开源模型的场景。

阿里云百炼 / 火山引擎:国内平台,支持通义千问和豆包等模型的微调。适合面向国内市场的内容创作者。

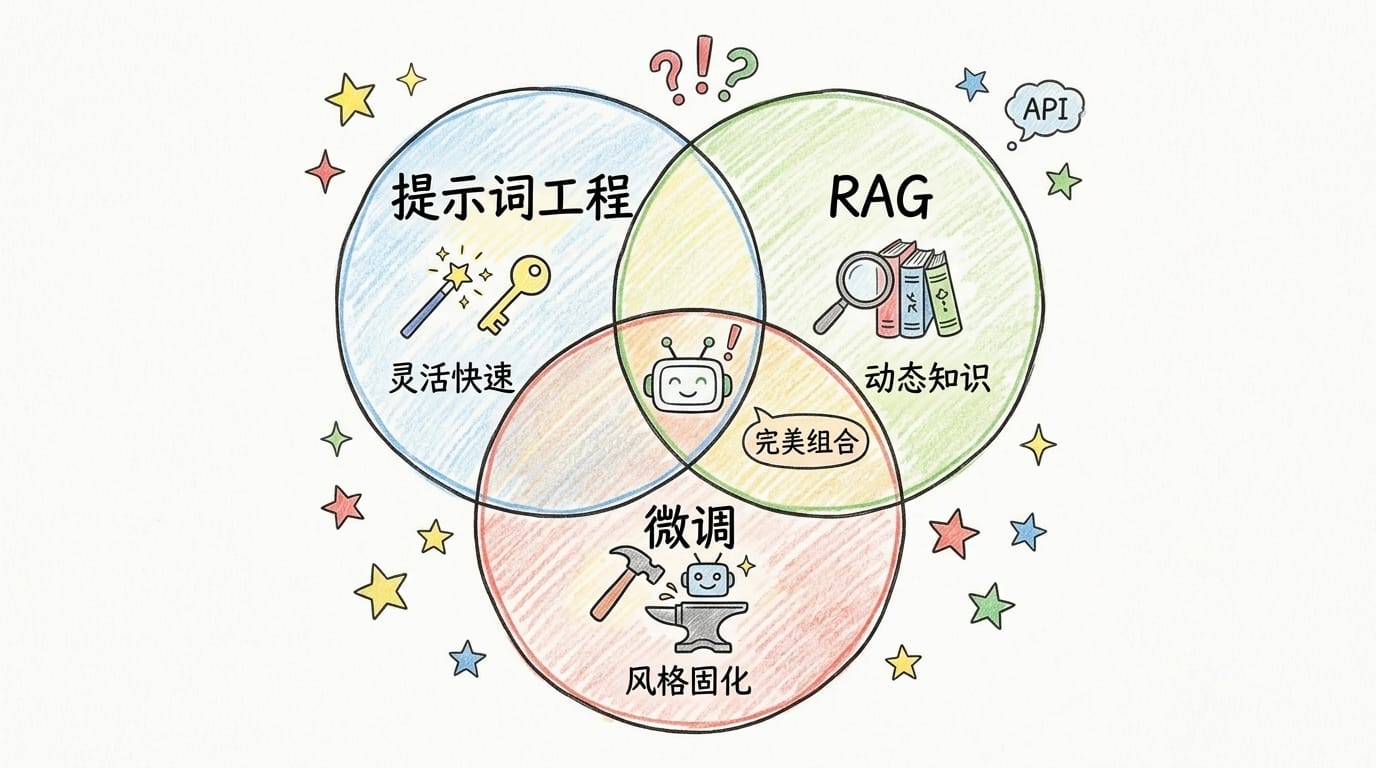

这三种方案解决的是不同层面的问题:

提示词工程:适合一次性任务、快速原型验证。零成本启动,灵活性最高,但一致性和深度有限。

RAG(检索增强生成):适合需要引用最新信息或特定知识库的场景。知识可以动态更新,但不改变模型的写作风格。

微调:适合风格固化、专业领域强化、批量内容生产。一次性投入后长期受益,但需要高质量数据集和一定的技术门槛。

三者并不互斥。最强的方案是:微调固化基础风格 + RAG 补充最新知识 + 提示词控制具体任务参数。

基于 100 篇女性作家文章微调的 Gemini 2.5 Pro 模型,在 n8n 工作流中批量生成了覆盖多个领域的图文文章:

每篇文章的 PDF 下载链接详见:微调效果展示页面

Q:微调需要多少篇训练数据?

根据我的经验,100 篇高质量文章是一个不错的起点。数据质量远比数量重要——100 篇风格鲜明的文章,效果好过 1000 篇风格混杂的。

Q:微调一次要花多少钱?

在 Vertex AI 上微调 Gemini 2.5 Flash 大约几十到上百美元,具体取决于数据集大小和训练轮数。微调完成后,调用微调模型的价格与标准 API 相同。

Q:微调后的模型会不会丧失通用能力?

不会。微调是在通用能力基础上叠加风格偏置,不会破坏模型的基础推理和知识能力。它只是让模型在输出时倾向于使用你的表达方式。

Q:能不能微调出多种风格的模型?

可以。每种风格分别准备数据集,分别微调,得到多个端点。在 n8n 工作流中根据需求切换调用不同的微调模型。

微调为个人 IP 的规模化生产打开了一扇新门。以前你需要在每次提示词里反复强调"我是谁、我怎么写",现在你只需要微调一次,模型就永远记住了你的风格。配合 n8n 的自动化工作流,从选题到成文可以做到完全无人值守。

但微调不是万能的——它适合风格已经成熟、需要规模化产出的创作者。如果你还在探索阶段,提示词工程仍然是更灵活的选择。

这是 n8n 系列的最后一期。下一期我们将进入 Claude Code 的世界——从零基础开始,用 AI 编程做出一套真正的视频剪辑软件。

每周精选 AI 编程与自动化实战内容,直达你的邮箱