Claude Code 最佳实践:从上下文工程到多代理协作的完整实战指南

按 CLAUDE.md、MCP、Hooks、Skills、子代理、上下文管理六大模块,逐个拆解最佳配置方案。附推荐清单和决策表,读完直接抄作业。

DeepSeek V4 预览版能不能接入 Claude Code 跑真实工作流?翔宇用 22 块 API 成本,让它自己建配图 Skill、写文章、生成配图,复盘它做对的地方、翻车点和适合的使用场景。

DeepSeek V4 可以接入 Claude Code 跑真实本地工作流。这次翔宇用 22 块 API 成本,让它自己建配图 Skill、写文章、生成配图;结论是能跑通、交付物齐整,但预览版在复杂 Skill 调用和既有项目约束上还不够稳。

今天,等了一年的 DeepSeek V4 预览版终于发了。翔宇第一时间拉出来测,这次不一样。

你现在读的这篇文章,是 DeepSeek V4 Pro 自己写的。 包括这句。包括下面每一个字。包括你滑动屏幕时看到的每一张配图。

翔宇给它的指令只有一段——

参考以前的配图Skill,新建一个使用GPT image 2 这个模型,再用这个 Skill 给这篇文章配图。顺便把整个过程写成一篇公众号,按翔宇的表达风格来写。

没有文件路径,没有代码框架,没有分步指令。就一段人话。

然后翔宇起身去做了点别的。回来一看,15 个文件、532 行 Python、一篇 3000 字的公众号、一组风格统一的配图,全摆在那了。API 账单 22 块钱。

综合感觉,能跑通,交付物齐整,但离让人眼前一亮还有距离。有些地方做得挺聪明,有些地方还是预览版的毛糙。

📌 提前说清楚

这次测的是 V4 自己参考以往规范和 Skill 新建 Skill、自己写文章,场景对它最友好。换成调用已有 Skill 或接手已有项目,难度会上一档。

别把这次当成 V4 的全貌。

这篇讲 4 件事——

外加一份 Claude Code 接入 V4 的参数模板,照抄就能跑。

今天发的是预览版,官方标的就是 preview。生产稳定性还在迭代。

两档旗舰:deepseek-v4-pro 和轻量 deepseek-v4-flash。两档都标配 1M 上下文、384K 输出、思考模式。1M 上下文多大?《三体》三部曲 90 万字,一个对话窗口能装大半部。

有几件事得先讲清楚——

V4 是纯文本模型,不支持图片音频视频的输入输出。需要处理图片的任务,得让它去调外部图像模型(GPT Image 2、Nano Banana 这类)。这跟 GPT-5、Opus 4.6、Gemini 3 那种原生多模态不是一个路数。

V4-Pro 总参数 1.6T(1.6 万亿),是 V3.2 的 2.5 倍。能力更强,Token 定价也跟着涨。

定价表如下——

| 档位 | 输入(缓存命中 / 未命中) | 输出 |

|---|---|---|

| Flash | ¥0.2 / ¥1 | ¥2 |

| Pro | ¥1 / ¥12 | ¥24 |

单位每百万 tokens。一次编程会话 50K 入 + 10K 出,Pro 不到 1 块,Flash 不到 1 毛。

官方定价页只明确写了两件事:价格以百万 tokens 计费,且产品价格可能发生变动。也就是说,现在这个 12 块的未命中输入价不是一个永远不变的锚点,后续要以 DeepSeek 官方价格页为准。

🏗️ 设计洞见

海外模型的涨价是能力溢价,国产模型的价格是被算力卡着的。芯片产能起来,价格就会松。

纯聊天、写稿、翻译,用 DeepSeek 官网就行。

想让 V4 写代码、做项目、调本地工具、跟自己的知识库联动,那就得接 Claude Code。接完之后它不再是聊天窗口,而变成能调工具、能读文件、能长时间跑任务的办公助手。

如果你还没分清 Claude、Claude Code、API 和 Skill 的关系,可以先看翔宇之前写的 AI 工具关系梳理;这篇默认你已经知道 Claude Code 是一个能执行任务的编程 Agent。

Step 1 · 去 DeepSeek 开放平台注册、充值、拿 API Key(sk- 开头)。

Step 2 · 这台电脑之前登过 Claude 官方账号的,先清 OAuth 残留。这是第一大坑,很多人切完一直 401 就是因为老凭据没清干净。

Step 3 · 在 ~/.claude/settings.json 的 env 区把附录的参数模板抄进去。DeepSeek 官方的 Claude Code 接入文档也给了同一组关键环境变量,尤其是 ANTHROPIC_BASE_URL、ANTHROPIC_AUTH_TOKEN 和 CLAUDE_CODE_DISABLE_NONSTREAMING_FALLBACK。

Step 4 · 避开三个坑——

| 坑 | 修法 |

|---|---|

错写成 ANTHROPIC_API_KEY |

第三方 provider 一律用 AUTH_TOKEN |

没禁 NONSTREAMING_FALLBACK |

DeepSeek 只支持流式,必须禁 |

| 超时用默认 10 分钟 | 1M 上下文场景拉到 50 分钟 |

Step 5 · 新开终端问它"你是什么模型",回答里出现 deepseek 就通了。

翔宇这次全档指向 Pro,没降级,结果 22 块出头。

日常活翔宇用降级组合——主干 Pro,轻活和子 Agent 换成 Flash。输入成本差 12 倍,同一趟活能从 22 块压到 5 块以内。

★ 翔宇的建议

模型不是越贵越好。日常分场景降档,能便宜 70%。

翔宇想测一件事——给一段模糊的人话,V4 能不能自己搞清楚要做什么、怎么做、做对了没。

不是选择题,是开放题。

任务前面已经写了,建配图 Skill、用 Skill 配图、按翔宇风格写文章。没给路径、没给框架、没给分步。

翔宇原本以为它会立刻开干。结果没有。整个过程分三个阶段。

它先跑到翔宇知识库里,把表达风格文件从头到尾读了一遍。

它读到翔宇用第三人称"翔宇"自称,爱用"那么""然后呢""比方说"这些连接词,有一份 24 个 AI 味词的禁用清单要避开。

读完风格文件,它又读了三份 GPT Image 2 官方文档。三轮搜索、六次抓取、几万字文档。

做完这步,它才写第一行代码。

💡 划重点

让 AI 先读文档再动手,能省掉后面调 bug 的 3 倍时间。

但 V4 这个"先读再动手"不是每次都出现。这次表现正常,换场景(比如接手现成项目)它可能跳过确认直接开干。

翔宇知识库里躺着两份它没见过的教材——它自己翻到了。

一份是翔宇的 Skill 开发规范,17 个文件 3 万字,管命名、目录、步骤格式、脚本边界、错误分类。另一份是翔宇之前自用的 Gemini 配图 Skill,垫图模式,稳但维护重。

V4 扫完之后做了件合理的事——没照抄。它判断 GPT Image 2 的中文字渲染是像素级的,纯文本提示词就够用,垫图可以砍掉,风格改成视觉参数矩阵。

但云存储三模式(腾讯云 COS、Cloudflare R2、本地)和语言闸门它都留了。它分得清哪些是基础设施,哪些是机制。

🏗️ 设计洞见

理解一个设计就是知道它为什么存在。能理解的才知道什么该改什么不该动。

做完前两阶段,它才动手。

风格系统:内容分 7 个大领域(AI 科技、商业金融、健康心理、教育科普、生活方式、文化历史、通用),每个领域定义 5 个维度的视觉参数(色彩、光照、构图、排版、质感),再建 50 多个关键词的自动匹配表。

核心机制叫视觉签名——同一篇文章的所有配图共享同一组风格参数,每张图的提示词开头都塞一份。这就是你看到的这些配图色调统一的原因。

两个脚本:generate_fal.py 359 行调 fal.ai 生图,upload_cos.py 173 行传腾讯云。加起来 532 行 Python。语法检查零错误。

但语法过不等于真跑通。边界情况(异常重试、超大图超时)还得后面实战里磨。

一篇文章:就是你正在读的。它回知识库读了翔宇的表达风格,翻了公众号爆款参考库,才动笔。修改度四到五成,翔宇手动调了些句子让呼吸更自然。够用,但还不能直接发。

一个会话从头跑到尾,没断片、没压缩。上下文占用 21%,API 账单 22 块。

翔宇这次没开省钱模式。用降级组合跑同一趟活能压到 5 块以内。剩下 79% 上下文还能再接 4 个同等任务。

主动补上下文。多数模型凭印象硬写,V4 会去读风格、读规范、读官方文档。这步是它成事的前提。

会做加减法。看到旧 Skill 它没拷贝改改就交,而是判断哪些是基础设施该保留、哪些是机制该升级。

主动搭架构。它没做成调 API 生图的玩具脚本,而是建了一套风格系统。

知道自己的边界。它在 Skill 主文档末尾自己加了一句——"本 Skill 已完成结构搭建与静态验证,实际生成质量需在真实文章上端到端测试后再评估"。翔宇没让它写。它知道自己跑没跑过真实场景,也敢明说。

复杂 Skill 调用识别偏弱——这是大坑。说"去服务器上查一下某个东西",本地明明有对应的服务器 Skill,V4 有时会"忘了"调,得把关键词说得非常明确才肯走。接手已有 PRD 和 CLAUDE.md 约束的现成项目,它会跳过全局搜索直接动手、跳过确认开干二十多分钟。约束经常性失效。同期 GLM-5.1 在这块明显更稳。这是这次最主要的短板。

偶尔冒英文。该输出中文的地方偶尔冒一两句英文,比方说步骤文档末尾来一句 Execution completed successfully.。手动改一下,一次会话 2-3 处。

工具调用有小抖动。Edit 工具对字符串精确匹配要求很严,V4 偶尔"记个大概"漏个空格,第一次改失败得重读再改。不卡死,多烧点 tokens。

长输出出过卡顿。写那个 359 行脚本时输出到 70% 停了将近一分钟没吐字。翔宇手都放键盘上准备按 Esc 了。对需要稳定跑批的生产环境,这是个隐患。

格式洁癖差一点。硬约束抠得准,软约束(表格前后空行、列表用短横还是星号)经常不一致,要手动过一遍。

推理质感离 Opus 还有距离。需要跨知识库多文件推理的步骤里它比 Opus 慢半拍,决策也偶尔浅一些。这是模型本身的差距,不是 bug。

再强调一次,这次测试的场景对 V4 偏友好。

"自己建 Skill" 的特点是任务边界由它自己定。没有现成约束要守、没有混乱代码要理、没有严苛偏好要对齐。

换个不友好的场景,比方说"接手已有 10 个 Skill 的项目,加功能但不破坏老结构",以它暴露的 Skill 调用和约束问题来看,大概率会翻车。

📌 记住这点

测 AI 模型的难点不在它能做到什么,在它能稳定做到什么。

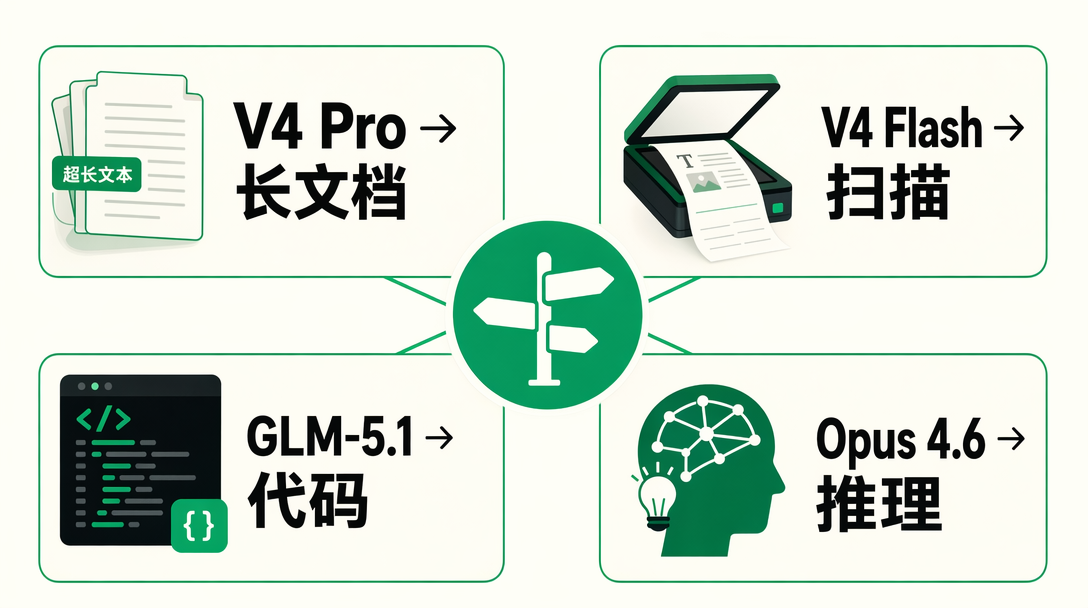

不是所有地方都推荐用 V4,也不是所有地方都不推荐——

| 场景 | 推荐用法 |

|---|---|

| 长文理解 / 长文档分析 / 小说阅读 / 长合同审阅 | V4-Pro 真正的杀手锏。1M 上下文一次装下几十万字,整本小说、长合同、整套代码库都能塞进来。GLM-5.1、MiMo、Kimi 的上下文都比它小,这是 V4 最明确的相对优势 |

| 知识库扫描 / 素材整理 / 翻译 | V4-Flash 性价比很高,¥0.2/百万 token 的缓存输入价,扫一圈几乎不心疼 |

| 代码开发 / 工程任务 | 更推荐 Claude Code + GLM-5.1。V4 在 Skill 调用和约束上有适配问题,正式版修好之前先观望 |

| 深度推理 / 创意策划 | 还是 Claude Opus 4.6 那种"咔地一下接通"的质感更稳 |

翔宇自己接下来怎么用——长文档、知识库扫描、素材整理、草稿生成让 V4 跑。主力代码活和严守约束的任务留给 Opus 和 GLM-5.1。

正式版出来翔宇会再复测,尤其是 Skill 调用那条硬伤修没修好。届时结论可能会变。

如果你的目标不是单个 Agent 写代码,而是让多个 Agent 分工跑一套业务系统,可以接着看翔宇的 OpenClaw 一人公司实战。V4 这种长上下文模型更适合做其中的素材扫描、文档整理和草稿生成,不一定适合直接当整个系统的调度中枢。

翔宇必须说清楚这点。不然读者拿着 V4 一试跑不出效果,会怪模型不行。

真相是——没有上下文,能力落不下来。

V4 这次能一把跑通,靠的是翔宇这边有三样东西给它喂料——

把同一段提示词喂给裸的 V4,没有知识库垫底,它最多给你一个能跑的 Skill 骨架。你的命名习惯、风格偏好、禁用词,它根本不知道。

翔宇在上一期视频 《Agent 知识库实战:打造一人公司 AI 内容生产线》 里反复讲过——

📌 记住这点

工具会变,模型会换。你沉淀的知识库,才是你这个人的数字分身。

模型是耗材,知识库是资产。

未来拉开差距的不是谁用上了更强的模型——模型谁都能用,领先几周就被追上。拉开差距的,是谁先认真沉淀自己的知识库。身份、风格、规范、工具、爆款、记忆、工作流,一层层码起来。

光盯着工具更新远远不够。真正的护城河是你自己的知识库。

更多同类文章可以从 AI 编程专题 继续看。

这段不是情怀话,是深度 AI 用户的切身感受。

用 Claude、用 GPT 的朋友被封号的事翔宇这一年见得不少,账号失效、充值卡被拒、中转站被打掉。辛辛苦苦搭好的工作流,一觉醒来跑不动了。

所以当 DeepSeek、GLM、MiniMax、Kimi、阶跃这些国产模型跑分越来越接近海外第一梯队——翔宇是真的松了一口气。

AI 早就不是尝鲜阶段,它是生产工具。工具一旦断掉,影响的是吃饭。

海外模型翔宇照用,哪个顺手用哪个。但心里得清楚,那终究是别人家的水龙头,什么时候关不由你。

🏗️ 设计洞见

国产模型的每一次进步,都是未来几年你能稳定用 AI 的底气。

你刚才读完的这篇文章——建它的模型,读了你接下来要用的配图 Skill。文章里每一张配图,也是它自己建的那个 Skill 跑出来的。

引擎是 GPT Image 2,最厉害的是中文字渲染像素级精准。以前用 Gemini 生图,画面里的中文字一出来就抽,GPT Image 2 之后这条路才算通了。

研究、设计、编码、写文章、配图。一个对话窗口,一次跑完,22 块钱。

不吹不黑,就这样。

DeepSeek V4 通过 Anthropic 兼容接口接入 Claude Code。核心配置是把 ANTHROPIC_BASE_URL 指向 https://api.deepseek.com/anthropic,用 ANTHROPIC_AUTH_TOKEN 放 DeepSeek API Key,并把主模型设为 deepseek-v4-pro[1m] 或 deepseek-v4-pro。

长文档分析、复杂知识库扫描和需要稳定推理的任务优先用 deepseek-v4-pro;批量整理、翻译、轻量子任务更适合 deepseek-v4-flash。Flash 输入价格低,适合扫大量材料;Pro 更适合做主干决策。

这次实测结论是先观望。V4 能完成开放式任务,也能读规范、写脚本、生成文章,但在复杂 Skill 调用识别和既有项目约束遵守上还不够稳。正式代码开发主力仍建议用更稳定的模型组合。

单轮聊天评测只能看模型会不会回答,知识库工作流能看它会不会读规则、调用工具、理解上下文、交付完整产物。真实生产里,模型能力必须落到文档、规范、工具和验证闭环里,才算可用。

本文提到的 Skill 开发规范、知识库骨架、配图流水线、40+ 生产级 Skill 源文件,都在翔宇的 AI 编程实操课 里。

AI 编程实操课(翔宇完整课程,从 Claude Code 到 OpenClaw 全流程):

国内版和国际版内容完全相同,根据你的支付渠道自行选择即可。

其他渠道:

在 ~/.claude/settings.json 的 env 区加上——

"env": {

"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic",

"ANTHROPIC_AUTH_TOKEN": "sk-你的DeepSeek密钥",

"ANTHROPIC_MODEL": "deepseek-v4-pro[1m]",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro",

"CLAUDE_CODE_SUBAGENT_MODEL": "deepseek-v4-pro",

"CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": "1",

"CLAUDE_CODE_DISABLE_NONSTREAMING_FALLBACK": "1",

"CLAUDE_CODE_EFFORT_LEVEL": "max",

"API_TIMEOUT_MS": "3000000",

"CLAUDE_CODE_MAX_OUTPUT_TOKENS": "384000"

}

省钱版:把 CLAUDE_CODE_SUBAGENT_MODEL 也换成 deepseek-v4-flash。翔宇这次实测为了看上限,子任务没降档;日常用可以分档。

官方文档——

每周精选 AI 编程与自动化实战内容,直达你的邮箱