学员实践:openbili AI 接入驾驶舱介绍

Calvin 是「翔宇工作流」的学员,方向是 AI 模型中转。他把这件事做成了独立站点「openbili」,覆盖 OpenAI SDK 兼容、模型路由、调用成本可见、失败可解释。本文将其介绍给关注同方向的读者。

内容创作者缺的往往不是写作能力,而是稳定的素材供给链。这篇拆解我如何把 Reddit 采集、选题提炼和三平台内容生产做成一个 Claude Code Skill。

如果你也在做自媒体,一定有过这种感觉:公众号该更新了,但完全不知道写什么。

打开搜索引擎,翻半小时,全是同质化内容。看看同行的推送,篇篇都比你快一步。你不是不会写,你是没有稳定的素材供给。

内容创作者最大的瓶颈,很多时候不是写作能力,而是素材供给链。

我也卡过很久。后来我发现了一个被中文创作者严重低估的素材库:Reddit。

Reddit 不是单纯的海外论坛。对中文创作者来说,它更像一个还没有被充分翻译和消化的原始素材市场。用户真实提问、真实吐槽、真实争论,评论区经常比帖子正文更有价值。

于是我把「从 Reddit 挖素材到产出三平台成品内容」的流程,写成了一个 Claude Code Skill,交给 AI Agent 自动执行。

Reddit 的价值不只是大,而是信息差。

很多中文内容创作者会去知乎、微博、B 站、小红书找选题。这些平台当然有用,但你看到的时候,往往已经被很多人写过一轮。

Reddit 不一样。它有大量细分社区,覆盖 AI 工具、编程、职场、消费、投资、副业、心理、教育、游戏、产品体验等话题。更关键的是,很多讨论还没有进入中文语境。

这意味着你看到的高赞讨论,不一定是可以直接搬运的文章,但很可能是中文内容里的新选题、新案例、新表达。

我最看重 Reddit 的两个特点。

第一,匿名性带来真实性。

很多用户没有人设包袱,说的都是具体问题。不是「我有个朋友年入百万」,而是「我试了这个工具,第三步卡住了,有人遇到过吗」。这种真实痛点,比包装过的经验贴更适合做内容素材。

第二,评论区比帖子更值钱。

一个帖子通常只是一个人的观点,评论区才是几十上百个人的补充、反驳、修正和延展。真正的金矿不在标题里,而在评论区的碰撞里。

Google 更像图书馆,Reddit 更像集市。图书馆适合查资料,集市适合听真实的人在吵什么、问什么、抱怨什么。

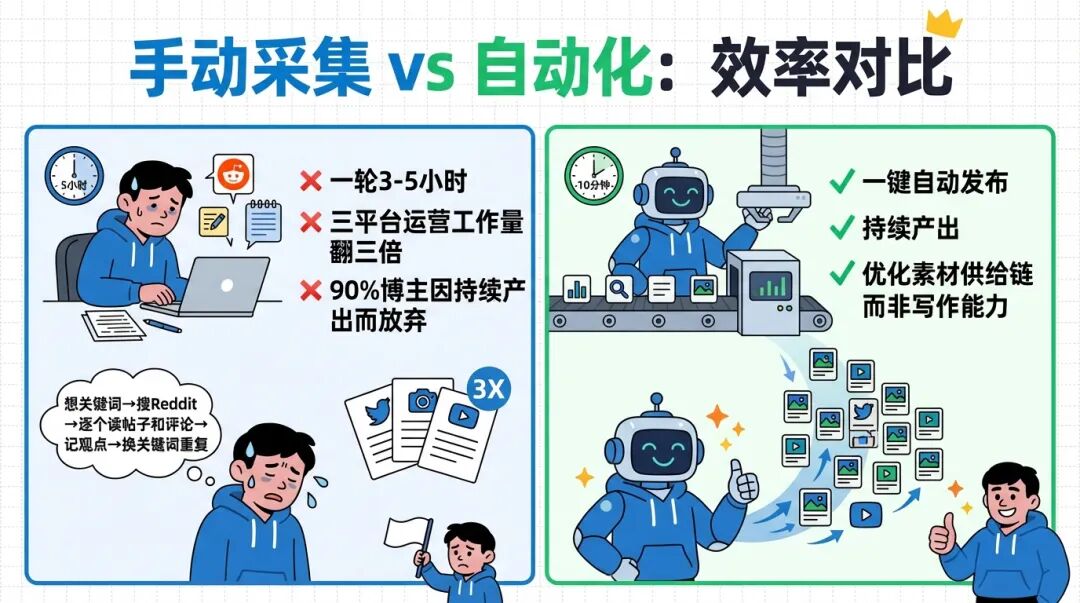

手动挖 Reddit 的流程很简单,也很痛苦。

你要先想关键词,再去 Reddit 搜,逐个打开帖子,读正文,读评论,记下有价值的观点,再换关键词重复一遍。

一轮下来 3 到 5 个小时没了。这还只是一个话题。

如果你同时运营 X、小红书和微信公众号,每个平台的表达风格还不一样,工作量会继续翻倍。

很多创作者放弃持续更新,不是因为不会写,而是因为持续找素材太消耗人。

所以我没有继续优化「怎么写得更快」,而是先优化「素材怎么稳定进来」。

我的思路很简单:把 Reddit 素材采集、筛选、角度规划、三平台改写这条链路做成 Skill。Agent 是执行者,Skill 是操作手册。手册写清楚以后,Agent 就可以一遍遍跑完整流程。

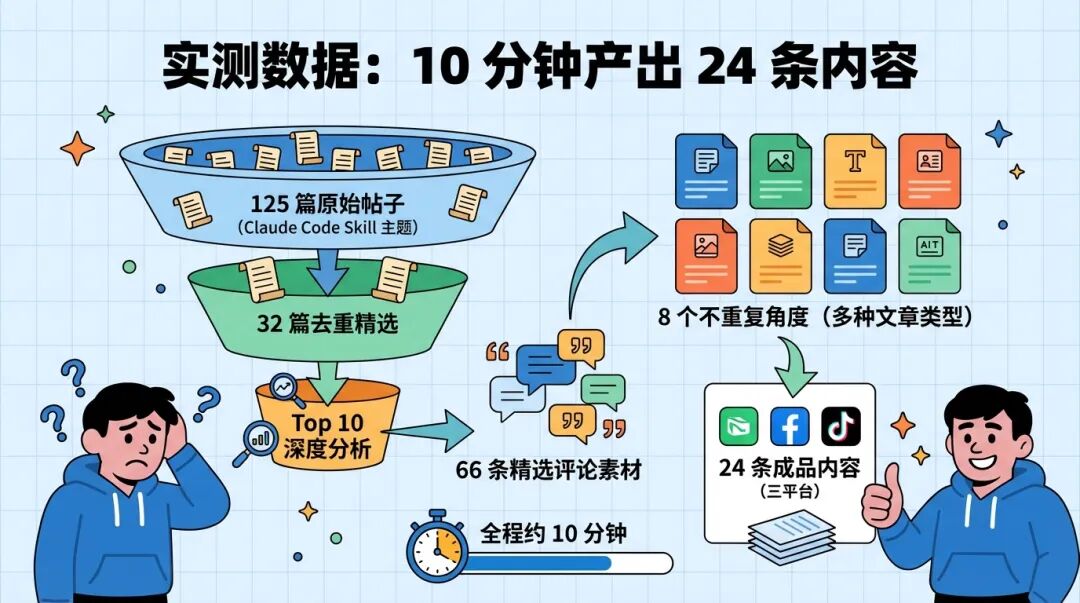

我用「Claude Code Skill」这个主题跑过一次完整流程。

输入只有一个主题词:Claude Code Skill。

Agent 先自动生成 5 个英文搜索关键词,覆盖核心原词、同义别名、教程使用、经验分享和痛点讨论。

比如:

Claude Code skill

Claude Code custom slash command

Claude Code skill setup create

Claude Code skill workflow tips

Claude Code skill not working issue

然后它执行 5 轮检索,每轮采集 25 篇帖子,一共拿到 125 篇候选。脚本按帖子 ID 去重,再用「点赞数 + 评论数 × 2」做热度排序。

为什么评论数权重要更高?

因为评论多通常意味着讨论更深。内容创作者需要的不是一个孤立观点,而是一组真实分歧、真实痛点和真实案例。

这次运行里,Agent 从去重后的帖子中取 Top 10 深入分析,获取了精选评论,再过滤掉无关内容,最后提炼出 8 个内容角度。

这些角度包括:

每个角度再扩展到三个平台:X 推文、小红书笔记、微信公众号文章。

最终结果是:8 个角度,24 条成品内容。

真正节省时间的地方,不是 AI 帮我写了几段话,而是它把从素材到选题再到多平台产出的整条链路跑通了。

这个 Skill 叫 xiangyu-social-reddit-researching。

它做的事可以用一句话概括:输入一个主题,自动从 Reddit 采集讨论,分析提炼内容角度,产出三平台成品内容。

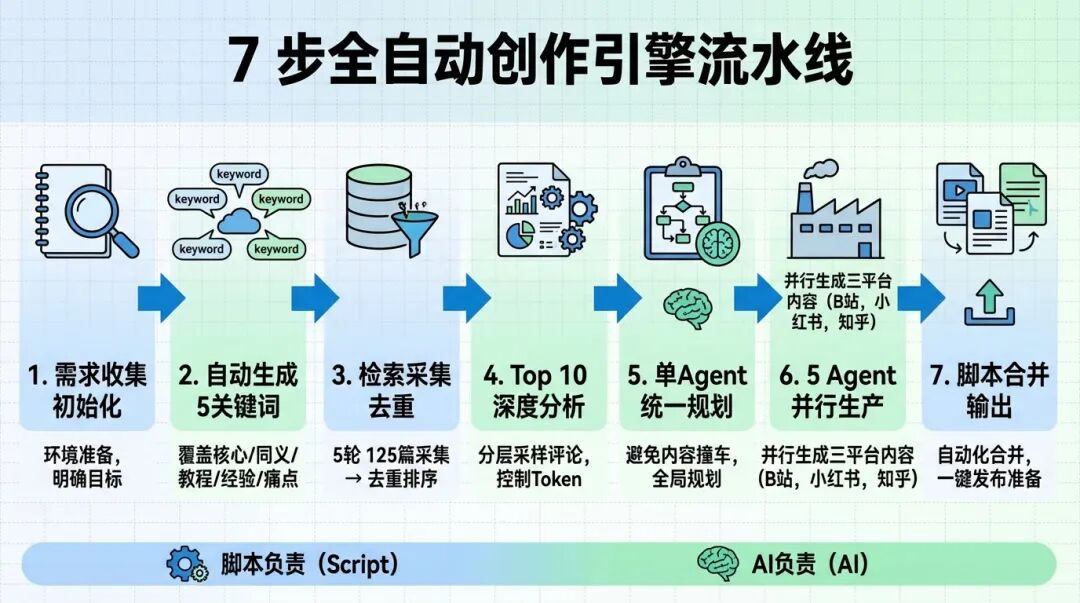

整个流程分 7 步。

你只需要告诉 Agent 一个主题,比如「Claude Code Skill」。

Agent 会初始化运行目录,创建状态文件,记录本次任务的主题、输出目录和当前进度。

这一步看起来普通,但很重要。没有状态文件,任务中断以后就只能靠记忆猜进度;有了状态文件,Agent 能知道自己做到哪一步、下一步该读哪个文件。

Agent 自动生成 5 个英文搜索关键词。

我要求关键词覆盖五个方向:核心原词、同义别名、教程使用、经验分享、痛点讨论。

核心原词保证不跑偏,同义搜索扩大覆盖面,教程和经验帖提供正面素材,痛点帖提供反面素材。

这里有一条铁律:每个关键词必须保留锚定词。

如果主题是 Claude Code Skill,关键词可以变化,但不能完全丢掉这个锚。否则搜索很容易跑到泛泛的 AI 工具讨论里。

脚本通过 Reddit 数据接口执行搜索。

每轮返回 25 条帖子,5 轮共 125 条。脚本自动去重,然后按热度排序。

这一步我坚持用脚本,而不是让 AI 自己处理。搜索、去重、排序都是确定性操作,脚本更稳定,也更便宜。

自动化的第一步,不是写代码,而是定义哪些事情值得自动化。

从去重后的帖子里取 Top 10,逐个获取正文和评论。

这里最关键的是数据瘦身。

原始帖子可能有几百条评论,全部喂给 AI 会导致上下文爆炸。所以我采用分层采样:高票评论、热门评论、最新评论都取一部分,每条评论截断到合理长度,正文也做长度上限。

原则不是给 AI 看所有数据,而是给 AI 看最有价值的数据。

信息过载是 AI 协作里非常常见的问题。真正的工作流设计,不是把所有东西塞进去,而是把输入控制在可判断、可处理、可复用的范围内。

到这一步,AI Agent 正式登场。

一个专门的 SubAgent 读取 Top 10 帖子的详情,先过滤无关帖子,再从相关帖子中提炼不重复的内容方向。

我不让多个 Agent 同时各自选题。

原因很简单:你让 5 个实习生各自想选题,大概率会撞方向;你让一个总编统一规划,角度会更稳定,也更容易形成组合。

这里的 Agent 扮演的就是总编。

角度确定后,多个子 Agent 分轮并行生产内容。

每个角度产出三件成品:

每个平台都有自己的表达约束。X 要短,小红书要有场景和话题感,公众号要有完整结构。

同一个素材源,不是复制三遍,而是按平台重新组织。

这也是内容工作流里最容易被忽视的一点:多平台分发不是一稿多发,而是一份洞察,多种表达。

最后一步交给脚本。

脚本把每个角度的内容碎片合并成完整文档,并附上来源表。

为什么不用 AI 合并?

因为合并文件、排序、拼接、写目录,都是确定性操作。它们不需要创造力,只需要稳定。

这也是我设计 Skill 的底层原则:确定性操作用脚本,创造性操作用 AI。

搜索、采集、去重、合并交给脚本;角度判断、内容生产、表达适配交给 Agent。

表面上看,这是一个 Reddit 素材采集工具。

但它真正复刻的,是出版社编辑的工作流。

编辑怎么工作?

选题、采集、筛选、写作、定稿。每一步都有输入、输出和质量标准。

Skill 的本质也是这样:把专家工作流固化成标准操作流程。

Agent 是执行者,Skill 是操作手册。当一个复杂任务被拆成足够清楚的步骤,Agent 就能替你跑完全程。

以后内容创作者会分成两种:有 Agent 的,和没有 Agent 的。

前者不是更会偷懒,而是更会拆活。后者还在一页页翻搜索结果,前者已经把采集、筛选、改写、分发做成流水线。

AI 时代真正重要的能力,不是你会不会写某个工具,而是你能不能把复杂任务拆成清晰步骤。

你能拆多细,就能让 AI 替你执行多少。

即使你完全不懂代码,也可以先手动复刻最小版本。

打开 Reddit,搜索你最想写的主题的英文关键词,按 Top 和 Past Month 排序,看前 5 个帖子,再重点读评论区。

不要急着写。

先记录三类东西:

一个下午的选题灵感,很多时候 15 分钟就能找到。

等你确认这条链路对你有价值,再把它做成 Skill,让 Agent 自动跑。

内容创作者的瓶颈,不一定是写作能力,而是素材供给链。

确定性操作用脚本,创造性操作用 AI,这是我现在设计工作流的基本原则。

以后比的不是谁更会打开工具,而是谁更会拆任务。

Reddit 只是一个入口。真正值得复用的,是这套方法:找到高质量原始素材,把筛选标准写清楚,再让 Agent 按你的流程稳定执行。

这就是 Skill 的价值。

Reddit 上有大量英文社区讨论,很多内容还没有进入中文互联网。它的匿名讨论、真实评论和高票沉淀,适合用来寻找痛点、选题、争议和用户原话。

它输入一个研究主题,自动生成英文关键词,采集 Reddit 帖子和评论,按热度去重排序,再由 AI 提炼内容角度,最终产出 X、小红书和公众号三平台内容。

可以先手动复刻最小流程:用英文关键词搜索 Reddit,按近一个月最热排序,阅读前 5 个帖子和评论区,整理痛点、观点和案例。自动化版本再交给 Claude Code 或其他 Agent 工具实现。

AI 编程实操课(翔宇完整课程,从 Claude Code 到 OpenClaw 全流程):

国内版和国际版内容完全相同,根据你的支付渠道自行选择即可。

每周精选 AI 编程与自动化实战内容,直达你的邮箱